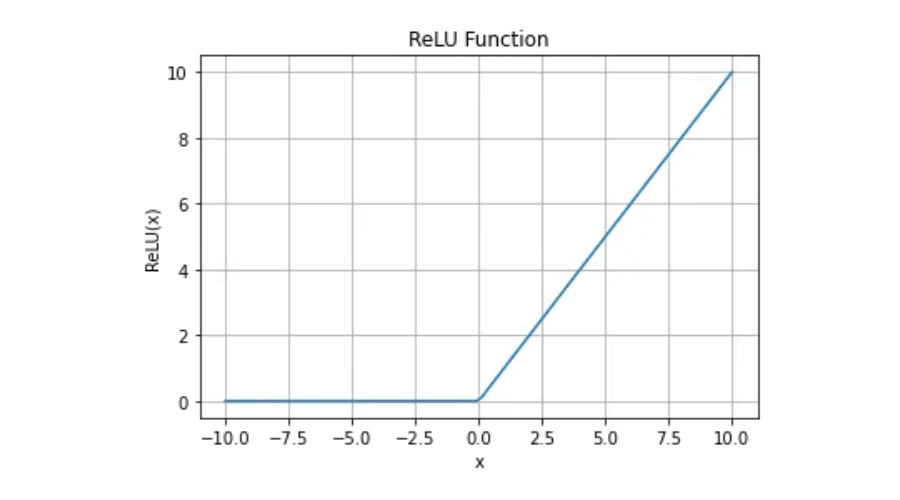

机器学习中常用的线性整流单元(ReLU)函数

作者:LR •更新时间:2025-08-09 01:57:00•阅读 0

什么是ReLU函数?

ReLU函数是定义为f(x)=max(0,x)的数学函数,其中x是任意实数。简单来说,如果x小于或等于0,则函数返回0。否则返回x。

ReLU函数的连续性和可微性

对于可微分的函数,它必须首先是连续的。ReLU函数满足连续性要求,但在x=0的导数不存在,因此ReLU函数在该点不可微。

那么为什么深度学习中仍然使用ReLU函数呢?

虽然ReLU函数在x=0处不可微,但我们仍可以通过微调优化算法来在深度学习中应用它。梯度下降是一种优化算法,用于**化成本函数。当ReLU函数在x=0处没有定义导数时,我们可以将其设置为0或其他任意值,并继续进行优化过程。这样我们可以利用ReLU函数的非线性特性来提高深度学习模型的性能。

总的来说,ReLU激活函数是深度学习网络中最流行的激活函数之一。它的简单和高计算效率使其成为训练过程中收敛性提高的重要工具。尽管在x=0处不可微,但这并不影响它在梯度下降中的应用。因此,ReLU函数是机器学习领域中多功能且强大的工具。

ReLU函数的优点

1.计算简单。

整流器函数实现起来很简单,需要一个max()函数。

2.代表性稀疏性

稀疏表示是表示学习中的理想属性,因为它有助于加速学习和简化模型。它使得神经网络的隐藏层激活可以包含一个或多个真零值,这意味着负输入也可以输出真零值。这种能力使得神经网络能够更好地处理大规模数据,并且可以减少计算和存储资源的需求。因此,稀疏表示对于优化神经网络的性能和效率非常重要。

3.线性行为

整流器函数与线性激活函数外观和行为相似。适用于线性或接近线性行为的优化。